不写一行代码:让AI给我开发个AI应用,基于Jetson板子

最近收到一款Jetson Orin Nano Super开发套装,我打算拿它来做个简单的AI应用开发...在没有任何AI应用和嵌入式应用开发经验的基础上...主打传说中的零代码开发。

对NVIDIA Jetson产品熟的同学应该知道,Jetson系列涵盖面向不同算力和规模需求的边缘AI应用,大方向应该算是嵌入式系统;只不过相比于更传统的嵌入式MPU,Jetson更着眼在AI算力上——且SoC的整体配置资源也给得比较足。

NVIDIA现在对Jetson应用定位是“机器人与边缘AI”,特别突出“机器人”应用——毕竟是老黄说的下一个ChatGPT时刻的载体嘛。从机器人的角度来看,之前我也写过挺多文章介绍NVIDIA对于机器人应用的“3台计算机”思路的,Jetson就是其中的第3台计算机,用在机器人本体。

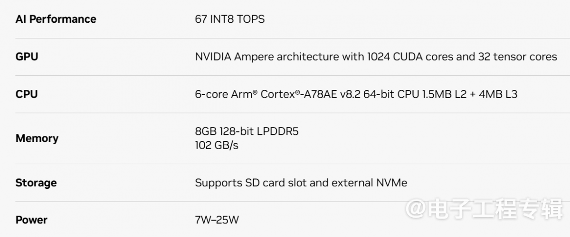

看名字就知道,Jetson Orin Nano是整个Jetson家族里的“nano”和经济适用型选手。去年底更新的Jetson Orin Nano Super Developer Kit的GPU部分标称AI算力67 TOPS(INT8),在边缘AI芯片中应该说是高算力水平——竞品典型像是应用于边缘的酷睿和酷睿Ultra系列。

其他配置情况看图吧,就不一一罗列了。认识和理解系统配置,有利于对其性能和应用有更明确的预期——虽然咱这次的开发只用到了这些硬件资源的冰山一角。

值得一提的是CPU部分选用的Cortex-A78AE是个安全关键型IP,某些ADAS/AD系列在用——应该和行业边缘应用可靠与稳定性需求有关,另一方面可能也在于NVIDIA自己不同应用的芯片设计同架构伸缩性考量。

开搞前,先聊聊Jetson Orin Nano Super

去年底黄仁勋本黄特别出镜,在他的网红厨房发布了Jetson Orin Nano Super——这次产品发布同期,是没有其他大活动的:可见NVIDIA现在是真的挺重视机器人,Jetson的一大应用方向就在机器人身上,充当机器人大脑的角色。

Jetson Orin Nano Super这个名称,尤其是尾缀“Super”,就特别像GeForce RTX游戏显卡现在都会在同代架构生命周期下半程特别更新Super版那样。这次的新品本质上就是对原本Jetson Orin Nano(8GB版)的同代换新,主要是性能释放更激进、性能进一步提升:

包括AI峰值理论算力从40 TOPS加到67 TOPS,内存带宽从68 GB/s加到102 GB/s,生成式AI性能1.7x提升(综合LLM和ViT)等;而且似乎是为了提高机器人开发的“accessible”,开发套装的价格还降了一半;发布会上特别强调说性能提70%,价格降50%,性价比提升3.5倍。

不过需要指出的是,去年底的媒体会上NVIDIA提到原版Jetson Orin Nano用户通过固件和系统更新也能获得70%的性能提升;可想而知Jetson Orin Nano Super并没有换芯片,仅系统层面性能释放更激进:后文会提到,大概率是系统更新后,支持了更高的功率。但Super和先前的非Super版应该有系统硬件层面的差异:NVIDIA的官方配置列表中能看到两者在IO方面的不同,比如说MIPI摄像头接口、PCIe扩展等...

当时NVIDIA还提到了Jetson Orin Nano降价的原因。大方向是说一方面让更多场景能用上AI,另一方面是过去18个月生成式AI因为模型蒸馏之类的技术,更多的生成式AI算法已经能够实时地跑在边缘及经济型设备上,Jetson Orin Nano Super就是其中之一。

还有个关键点是在NVIDIA看来,2025年机器人市场会大幅增长——主打机器人是AI从虚拟世界走向现实世界的载体;而且NVIDIA也在押宝生成式AI之后的下一个爆点,也就是机器人,Jetson自然就是该布局的一环了。

还有特别值得一提的是软件:Jetson在边缘市场的主要优势我觉得还是软件,就是NVIDIA AI那套stack。在Jetson算力水平上跑NVIDIA AI全栈的问题也不大了,包括了CUDA, 各种加速库——CuDNN, TensorRT和各种计算机视觉加速库之类的;还有就是再往上层PyTorch之类的AI框架及模型。

这些东西在“开发者套装”里面主打“开箱即用”,虽然其实做“开发”多少还是有些前期工作要做的。

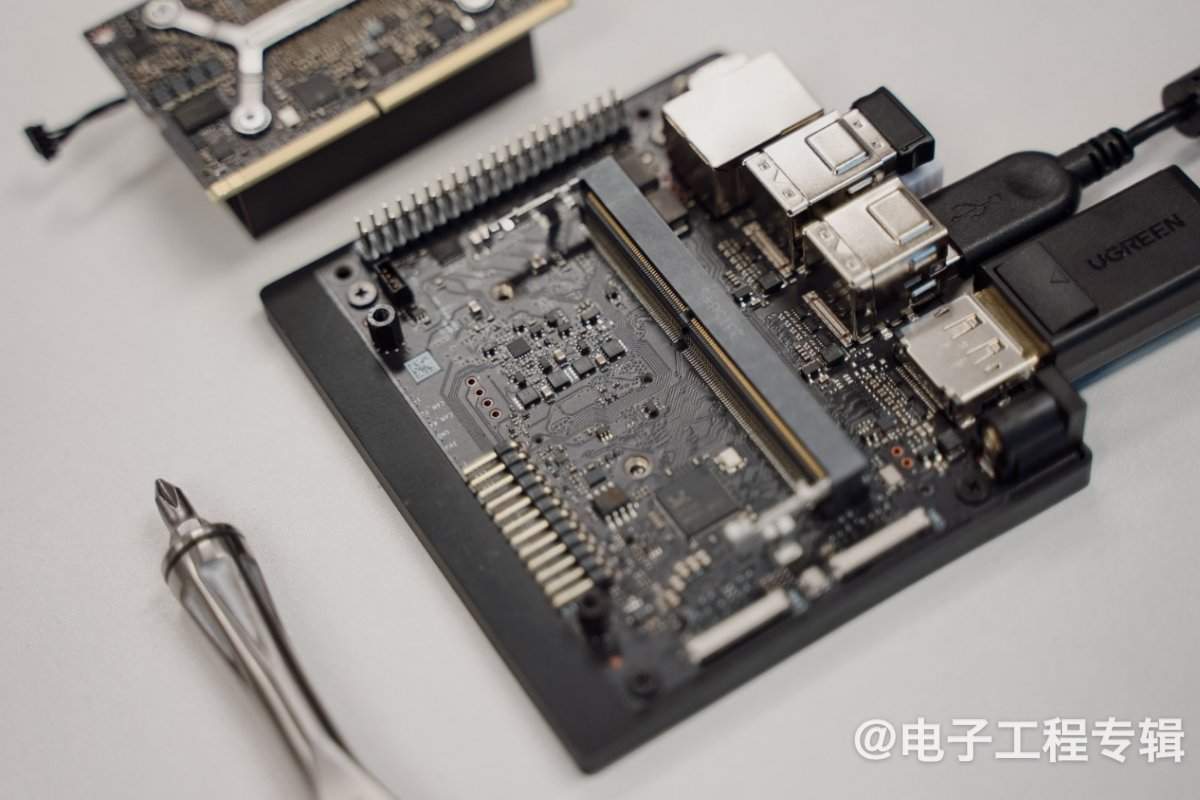

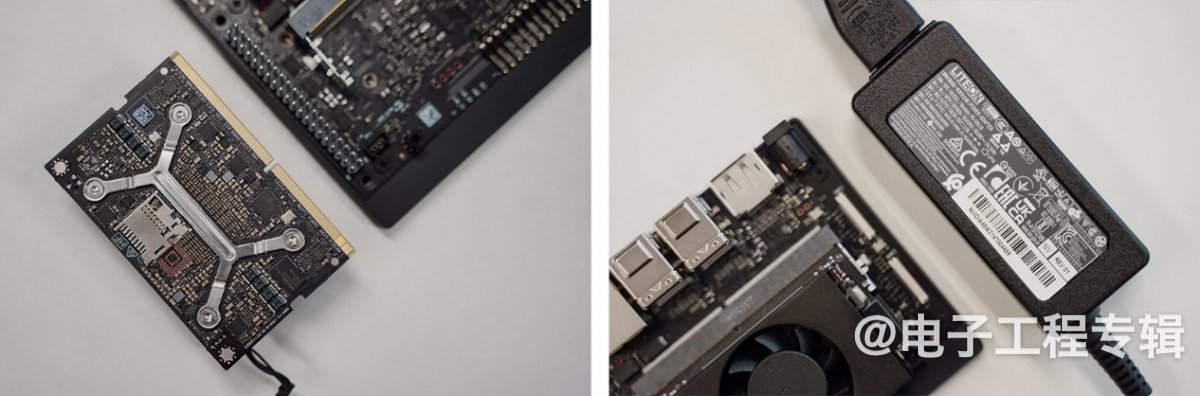

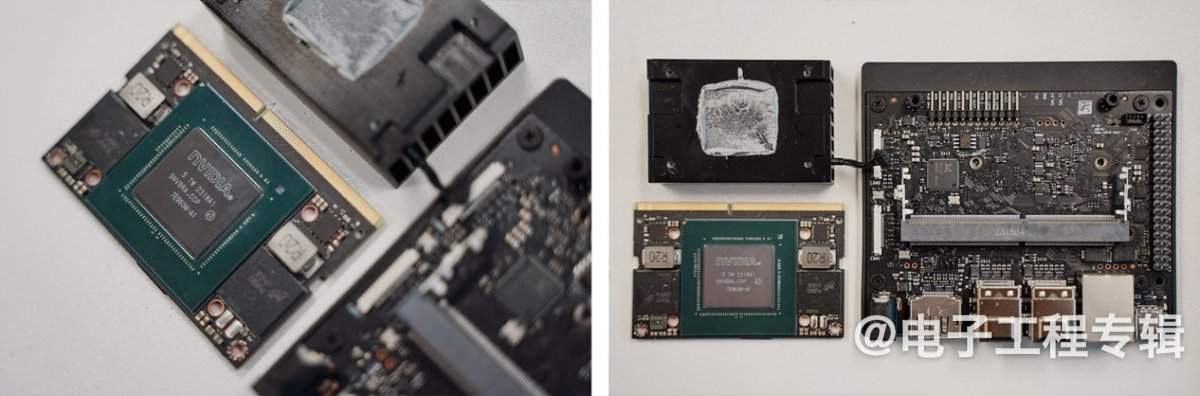

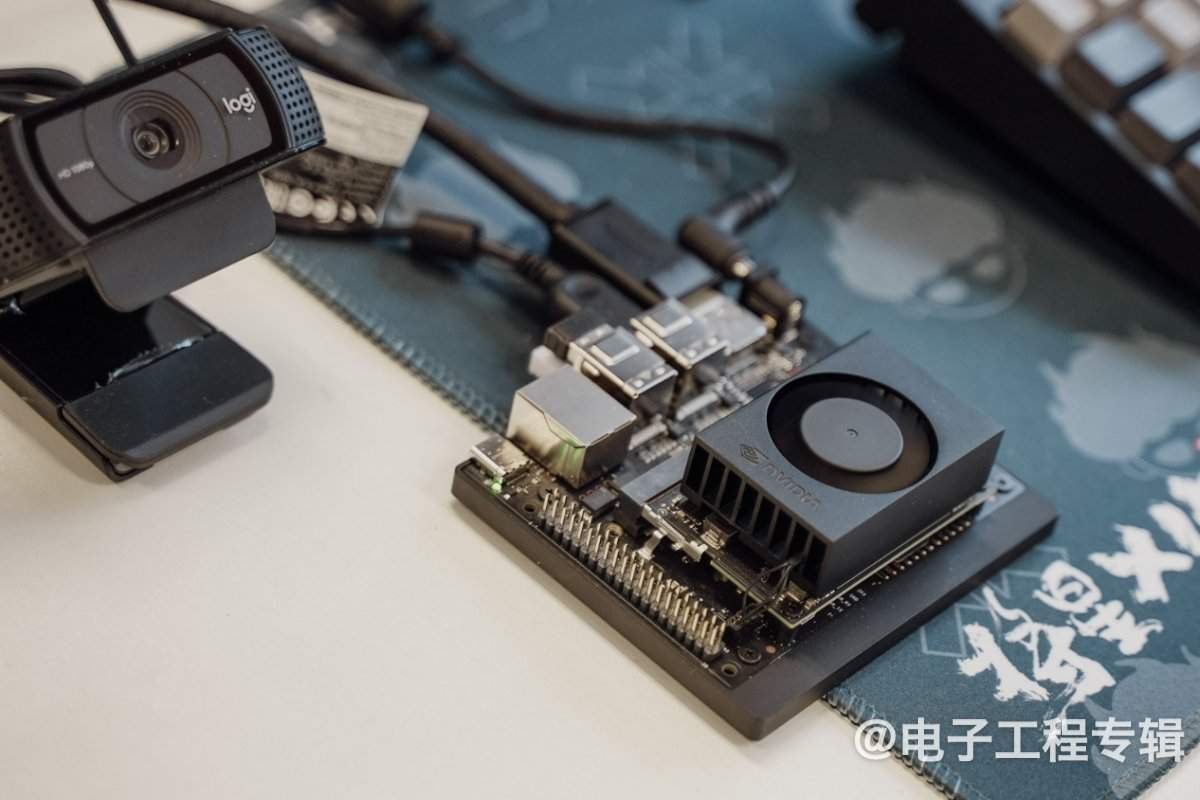

▲ 除了外置电源适配器(45W, 19V),这个开发套装的主体是由两部分构成的:Jetson Orin Nano模组 + 参考载板;前者接插在后者之上;

▲ Jetson Orin Nano模组之上有个小风扇散热器,揭开这个散热器就能看到下面的Jetson Orin Nano芯片;这片die顶盖标识字样TE960M-A1——NVIDIA官方并未公开这片die的参数信息,仅知为Orin Nano 8GB准备;芯片两边各一颗美光DRAM die stack...

▲ 载板上提供的接口还是挺全的,包括4个USB 3.1 Type A,1个USB-C,1个DP视频输出,1个千兆以太网口;另外也有MIPI CSI摄像头接口,以及用于弹性扩展的40-pin header;

▲ 载板背面:对像我这种开发小白而言,预装WiFi/蓝牙模组还配天线,还是省了挺多麻烦的;

开始开发,但一行代码也不写

这次时间比较有限,咱就不在8GB RAM设备上跑LLM了——放到下次开发行程里。另外好不容易有机会玩一玩算是开箱即用、啥啥都准备就绪的Linux,原本计划跑一跑benchmark基准测试的,但也没赶上(而且也没有啥对比的设备),都放到下次吧。

要做开发的第一个问题是:开发个啥?Jetson社区项目提供了几个样例方案,包括什么Hello AI World, 智能小车之类的。基于“成本可控”需求,我觉得其中的“实时人体姿势评估”——也就是现在很多展会上常见的追踪人体四肢行动demo,好像是最适合我的;虽然后来发现该应用项目下,NVIDIA官方给的预训练模型下载受限,所以换了个AI对象识别的开发目标,毕竟都是AI CV类应用嘛...

不过有两个最现实的问题:(1)我虽然会写代码也会写一点算法,但实操经验为零,熟练度为负;(2)Linux操作基本全忘光。现在不是有生成式AI吗?我让AI从零开始帮我开发,是不是还挺靠谱的?

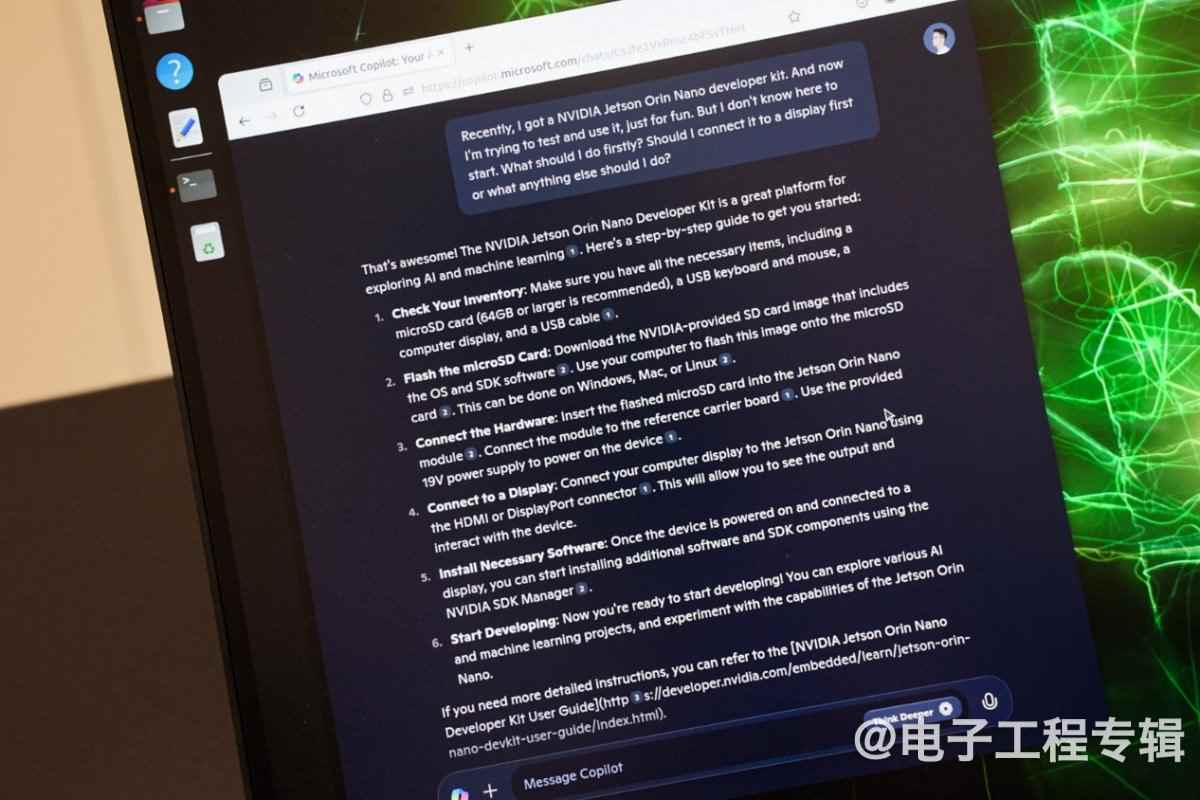

LLM服务也就是对话机器人,我选择了微软Copilot(Pro版,可能基于GPT-4o)。其实在选陪伴开发的对话AI时,我还是有过其他考量的,候选包括DeepSeek, Copilot, Claude等。最后选Copilot是因为我用Copilot Pro付费版也1、2年了;

且用这些AI来指挥我开发之初,DeepSeek和Claude在具体的指导建议上都出了些岔子:比如DeepSeek(知乎直答)似乎还不能准确认知Jetson Orin Nano Super(导致后续给的操作步骤全部都有问题);所以最后还是选了Copilot。

起手提需求

丢给Copilot的第一个问题是:我现在拿到了Jetson Orin Nano Super开发套装,准备做个相关于计算机视觉的应用开发,但我零基础什么也不会,你一步步告诉我该怎么做;并且向它明确阐述了,最后要达到什么样的效果;以及该开发并不用于实际生产,而只用于展示。

Copilot表示:没问题。于是AI加持下的AI应用开发就开始了。

烧系统,更固件,看B站...

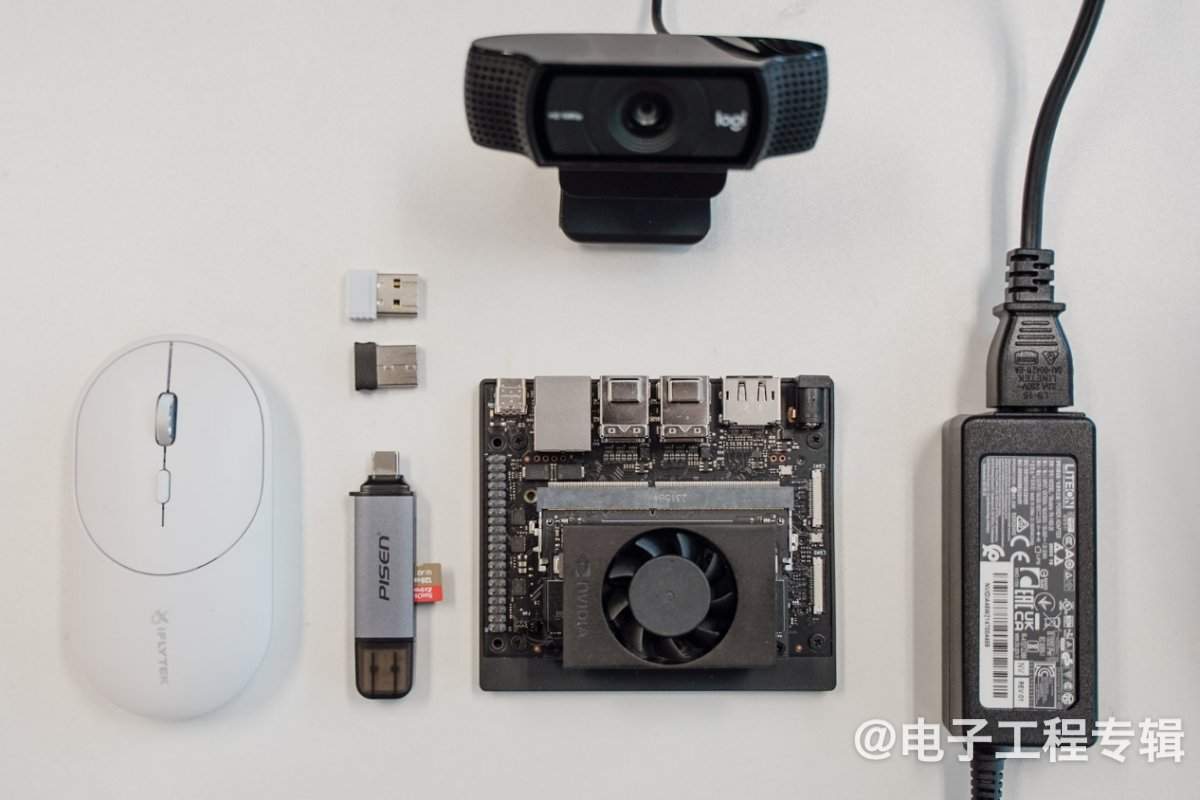

首先我让Copilot告诉我,需要准备些什么。Copilot说,既然要开发对象识别应用,那首先需要个摄像头;另外Jetson Orin Nano跑起来还需要一张>64GB的microSD卡;还有支持DP连接的显示器、USB键盘鼠标。

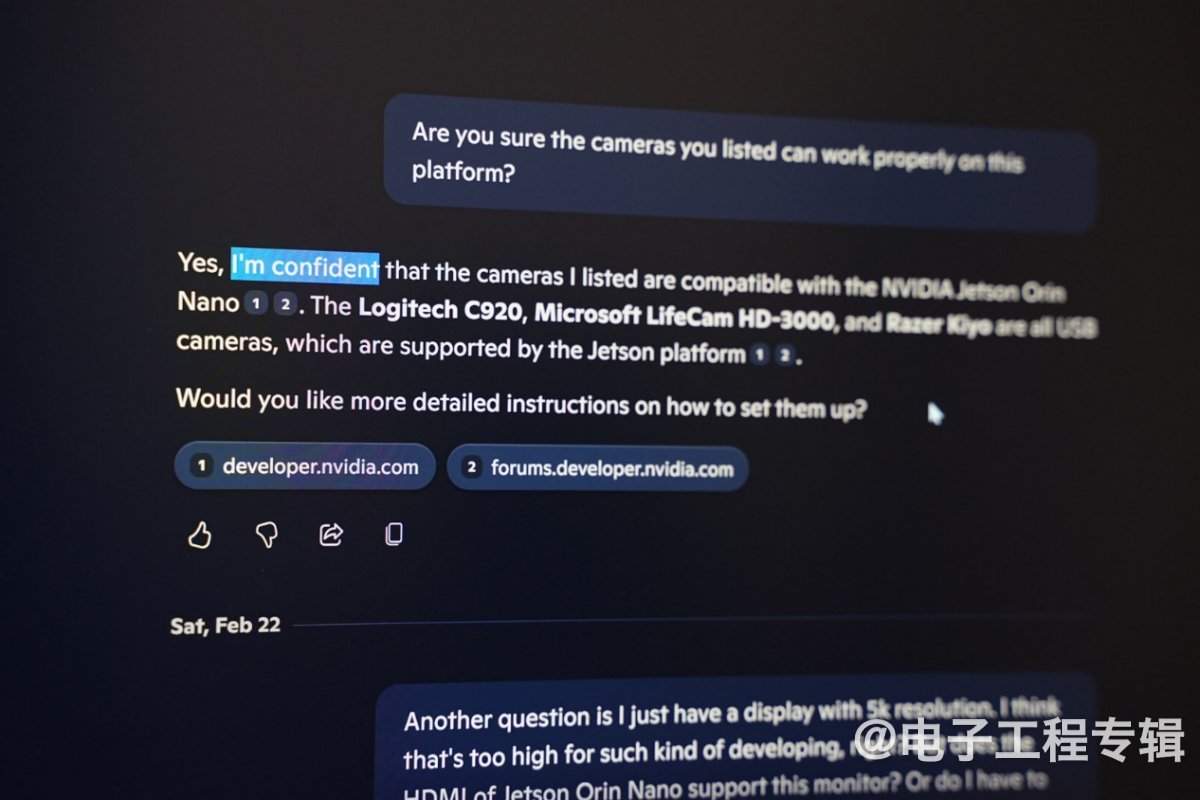

我说这还不够,你要把购买硬件的具体型号告诉我。在摄像头的选择上,Copilot推荐了罗技C920(不知道Copilot和罗技有没有商务合作...);我又追问了一次:你确定这款摄像头可以用在Jetson Orin Nano上吗?Copilot拍着胸脯回复:我办事,你放心(I'm confident......)

I'm confident, 非常自信…

集齐所需硬件…

所需装备全部买齐,就可以按照NVIDIA官方的安装指南开整了——顺带一提,安装指南的链接也是Coplit提供的。常规的大方向思路是:

(1)先借助一台PC给microSD卡刷入JetPack(截止发稿前的最新版为JetPack 6.2);

(2)将microSD卡插进Jetson Orin Nano开发板,再给板子接上键盘鼠标和显示器;

(3)可以开发功能或应用了...

这个思路的确是基本体现了“开箱即用”理念的;虽然实际情况不会这么简单:尤其是Jetson Orin Nano拿到手,首先就要做固件升级;尔后先给microSD卡刷入一个旧版系统,启动后再做固件升级;

然后再给microSD卡重新烧写最新版JetPack系统,再启动更新一次固件;令固件与系统达成最终匹配及最新版本以后,就可以开始后续的开发了。NVIDIA在这方面给到的资料支持还是挺丰富的,包括如何操作的视频及保姆级操作教程;且全流程仅基于microSD卡,所以折腾程度不高。

如果在意存储性能,也可以接NVMe SSD——那就需要一台跑Linux的PC,基于NVIDIA SDK Manager来操作了——基于咱这开发主打怎么方便怎么来,所以我很自然地选择了用microSD卡。在一轮刷写之后,启动进系统了...

感觉如果不是microSD存储系统性能差点儿,这么个小板子就已经能用来日常办公了:除了硬件配置基本够用;JetPack SDK就基于Ubuntu,Jetson Linux本质上就是个NVIDIA深度定制版Ubuntu;完全不需要关心驱动问题,图形化界面一应俱全,里头还有应用商店;关键是为包括CUDA在内的NVIDIA AI全栈提供丝滑支持。

所以进到系统头一件事就是装个浏览器,然后打开B站看看能不能播4K视频:完全没问题...毕竟Jetson Orin Nano本身就带H.265 4K60解码单元。从某种程度来看,Jetson Orin Nano就是台小PC:虽然我们没来得及测性能,但换用NVMe SSD的话,作为PC来用似乎是完全可行的。

系统启动,先看B站…

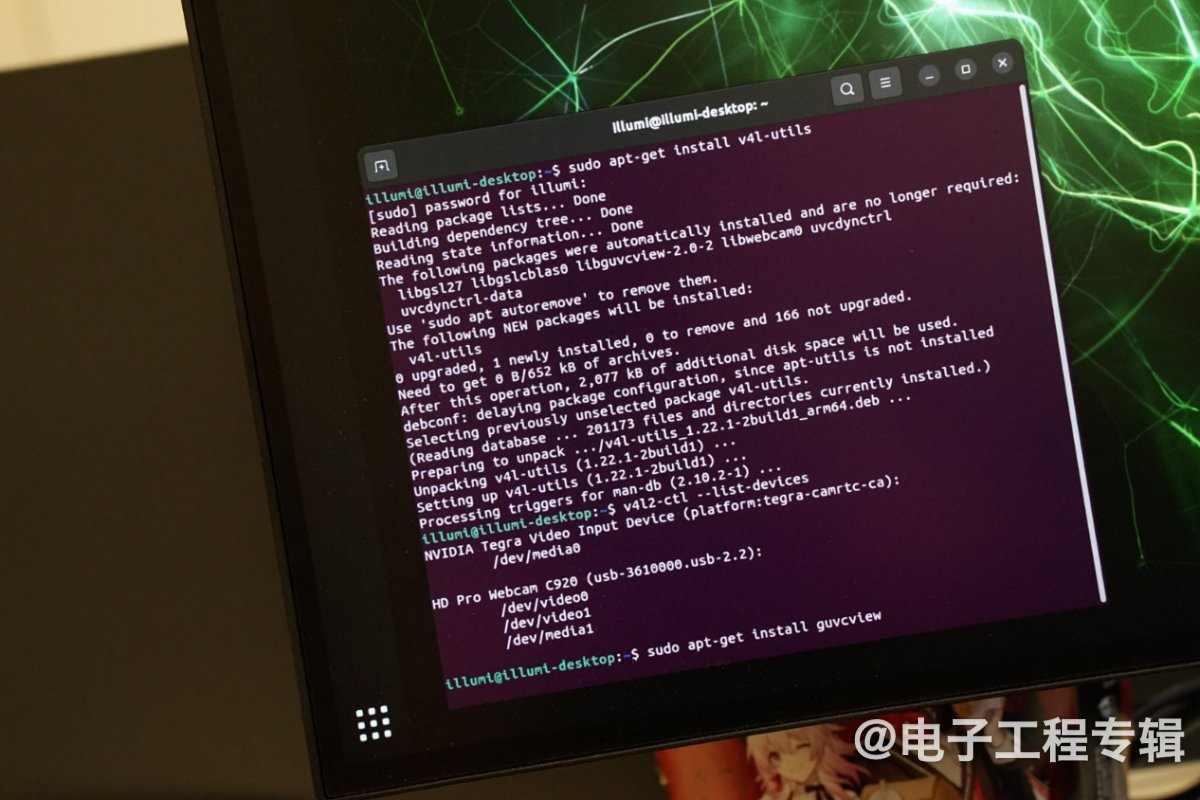

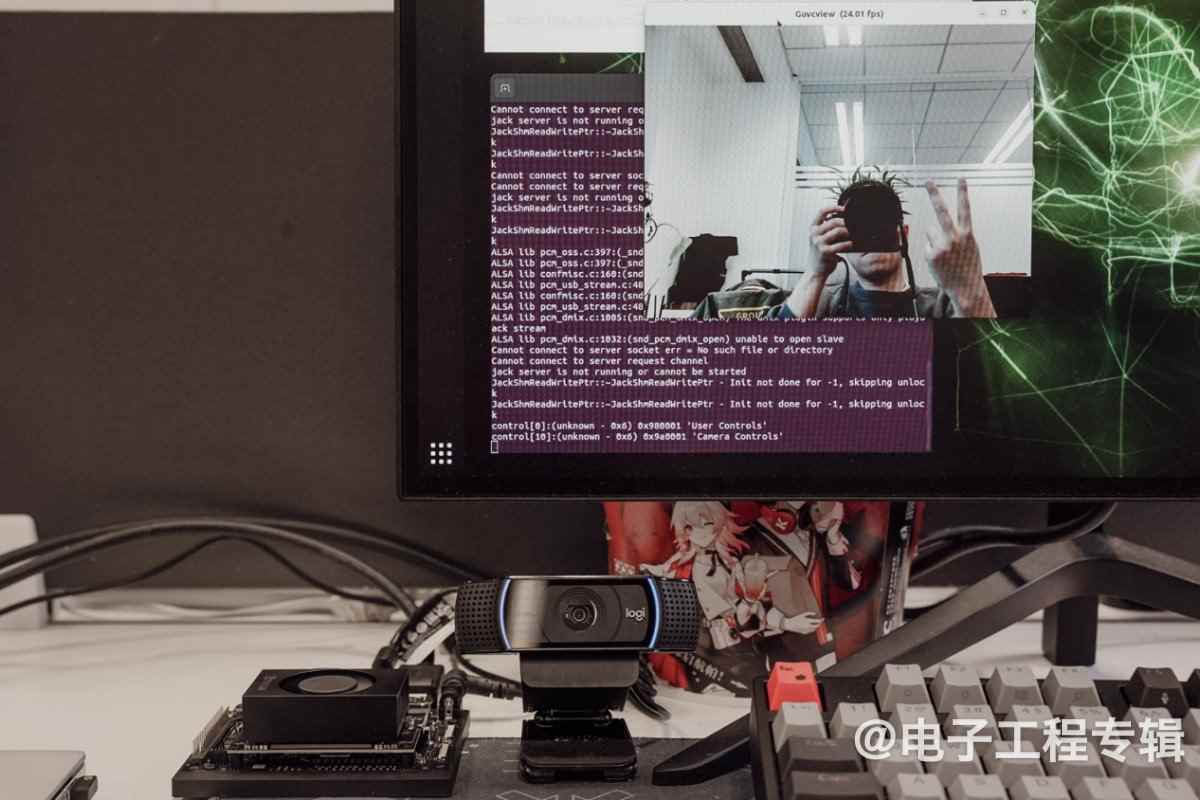

另外既然买了罗技USB摄像头,当然有必要先试试它能不能在Jetson Linux中被正确驱动,毕竟这不是NVIDIA官方推荐配件:给Copilot下达的指令是,摄像头已经买好了,如果不能用看我不打死你......在胁迫下,Copilot指导安装Video4Linux(V4L)框架;然后用Guvcview视频app启动测试,没有任何问题~

成功让摄像头跑起来了,这些指令也由Copilot倾情提供

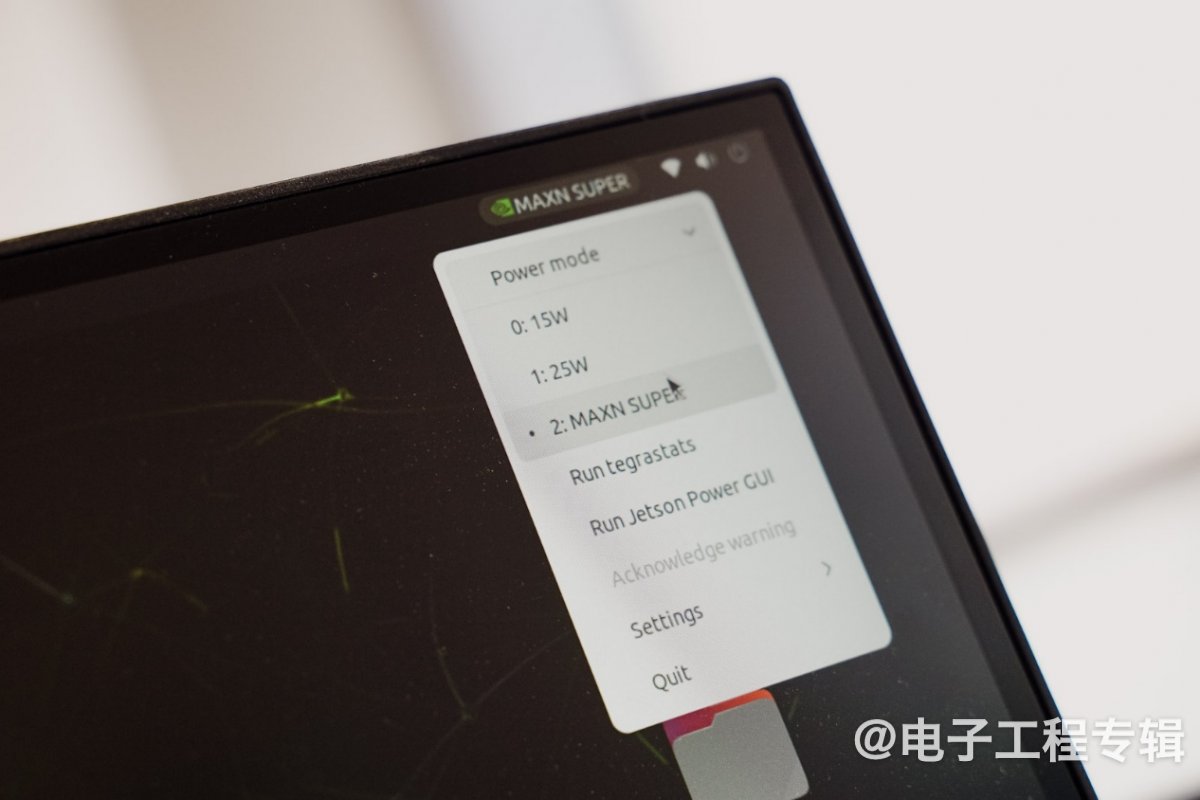

值得一提的是,如前所述Jetson Orin Nano Super相比旧版性能提升70%,功耗释放上限提高了。所以桌面导航栏的功耗模式选择中,在15W和25W两档之外多出了一个“MAXN SUPER”选项——具体多少W我没测,猜测是峰值性能释放给到了更宽的功耗阈值,大约主要是为生成式AI准备的。

装依赖包,让AI解决各种问题

有人问这东西能不能玩3A游戏,毕竟是NVIDIA GPU。抛开操作系统不谈,虽然Jetson Orin Nano 8GB有1024个CUDA core,也有固定图形渲染单元,还支持Vulkan 1.2+之类的API;但它应该不像GeForce RTX那样着眼于堆专用图形单元,GPU堆料的注意力主要是放在了AI和通用计算加速上的。

这片die看起来是不是也很适合玩游戏?

从Jetson产品详情介绍来看,其图形特性支持甚至还包括了光线追踪、mesh shader、VRS可变速率着色、ASTC(自适应可扩展纹理压缩)等,毕竟是Ampere架构嘛;但没有列出具体堆了多少料——后续我会去测一下图形渲染性能。

不过从粗粒度信息就不必抱什么指望:25W功耗释放、1020MHz的GPU最大频率,以及102GB/s的存储带宽,想也知道这东西不是拿来玩游戏的——人家就是个正儿八经的边缘AI芯片。

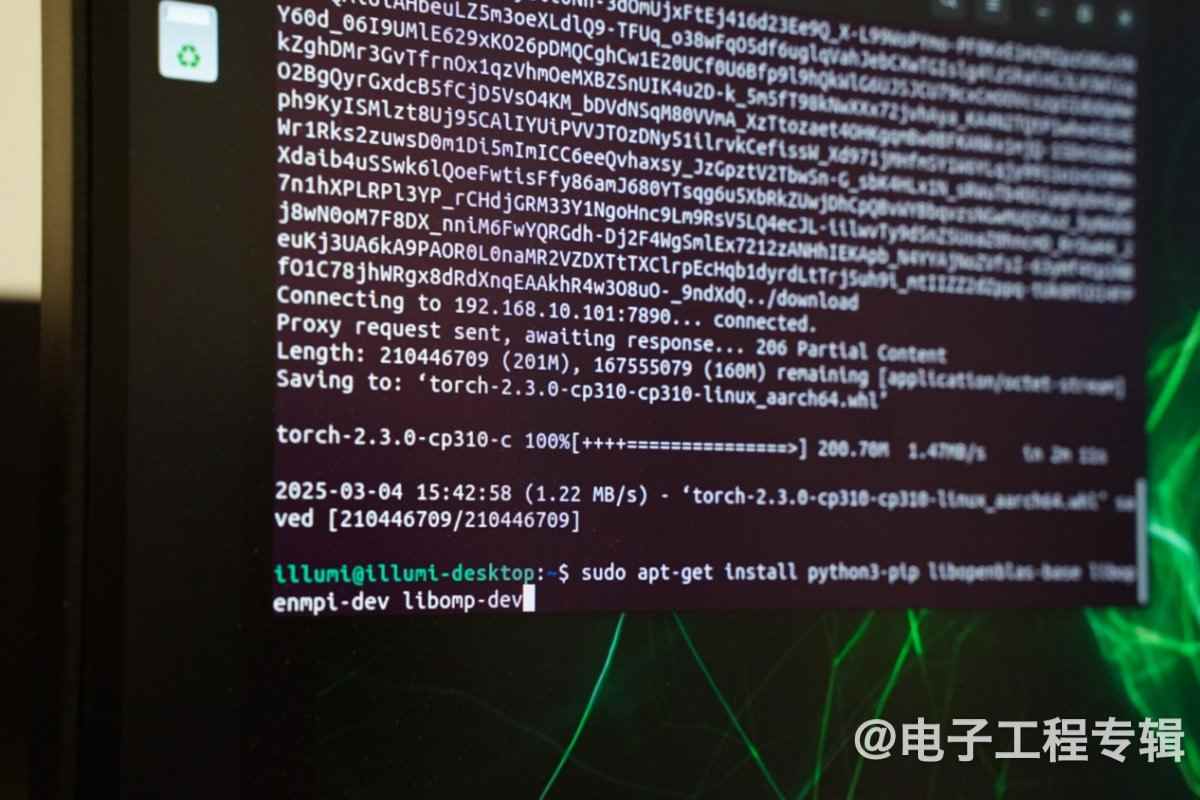

好了,接下来该正经做开发了。还记得目标吗?写一个基于AI的对象或物体识别的程序。按照Copilot的指引,在CUDA生态内,完成这件事的常规操作首先要做的就是装PyTorch和Torchvision。

PyTorch就不需要做介绍了,Torchvision也是PyTorch生态的一部分,是由Meta主导开发的开源机器学习框架:专为CV计算机视觉设计的。用Torchvision整体还是比较方便的,其数据集包括ImageNet, CIFAR, COCO等;关键它与我的开发目标完全对齐:提供包括图像分类、对象检测、分类等预训练模型。

还有一点,NVIDIA官方样例程序的人体姿势识别(torch2trt)也依托于PyTorch和Torchvision——都是CV类应用嘛。NVIDIA给出了安装这俩框架的详细教程——包括针对不同JetPack和CUDA版本,安装对应的PyTorch和Torchvision版本;安装指引中甚至还有安装后的依赖包验证——还是很大程度解决了可能存在的兼容性或其他潜在问题的。

在我的这个demo开发中,安装依赖包这一步是占用时间最多的。做过类似开发的应该也都知道,依赖包安装可能遇上各种幺蛾子:版本号不对啦,依赖包的安装顺序啦,奇怪的报错啦等等...

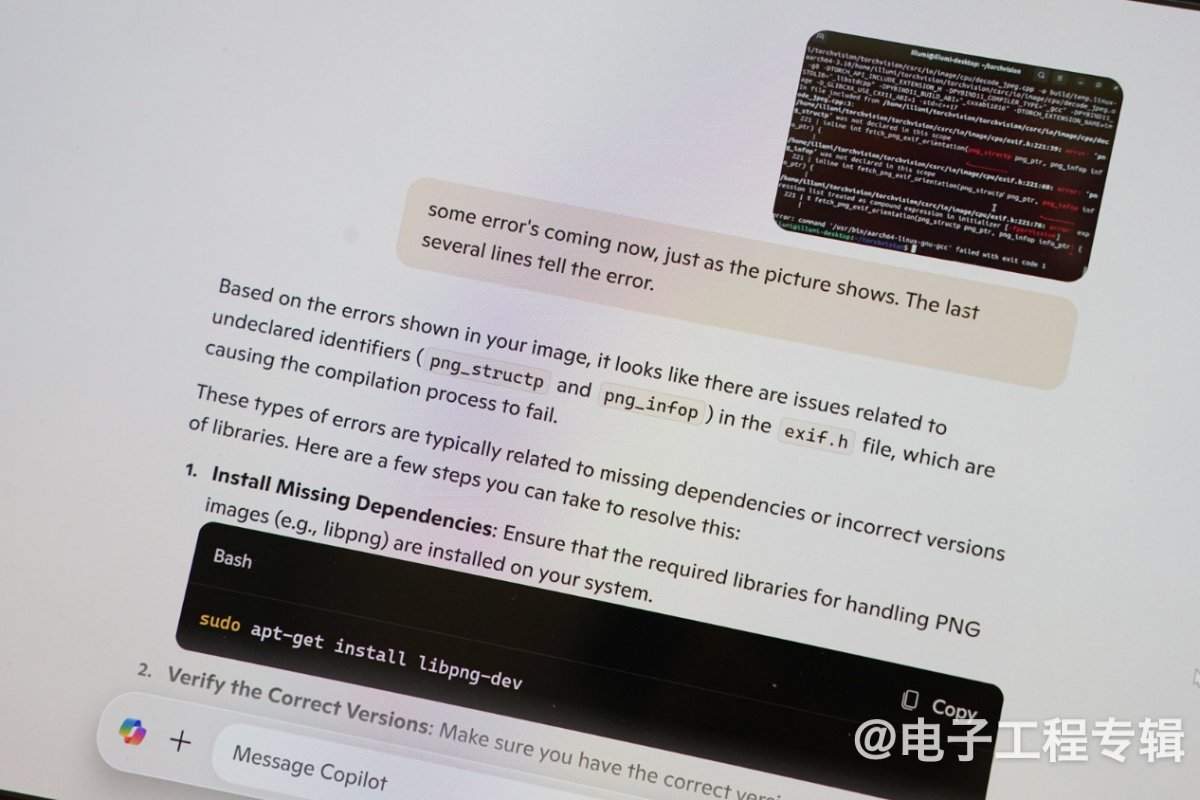

其实NVIDIA的安装教程和他们写好的安装脚本基本已经解决了95%的问题,还剩5%还是要看脸——这时候Copilot就能大显身手了。我的方案是:在任何一步遇到问题,就拍照发给Copilot看报错信息;Copilot的确很特别给力:除了看懂图片和报错信息毫无压力,还能给出靠谱的解决方案。

给Copilot发了安装报错信息,它立刻给出了解决方案

- 比如告诉我某个报错信息应该是没有装好前置安装包,然后给我一条命令——执行一下,问题立马解决;

- 再比如因为网络问题,某个repo始终clone不下来,试了各种方式都不行——Copilot建议命令里面加depth参数先缓缓,这对像我这种于Linux命令完全不熟的人而言真的是救星;

- 还有比如某个脚本执行时间很久,我拍了照问Copilot是否正常,Copilot回复:太正常了,有点耐心吧...

看来现在的LLM还不只是帮你开发,还真是顺带给你提供情绪价值。

AI程序诞生,效果还挺好

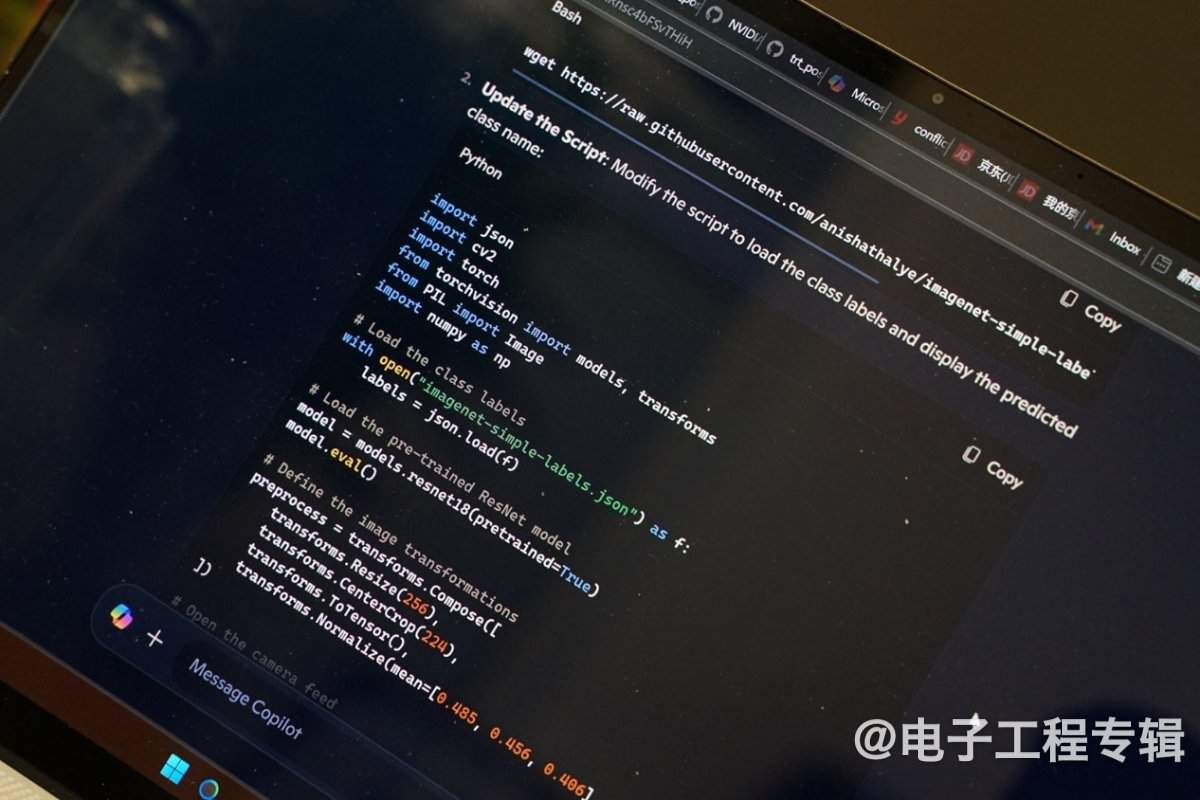

对于demo程序而言,真正开发这一步就没那么复杂,毕竟不是写一个要全面投入生产和商用的app。用于最终物体识别的py脚本也是让Copilot一手搞定的,我是真的一行代码也没写。

Copilot直接甩出代码

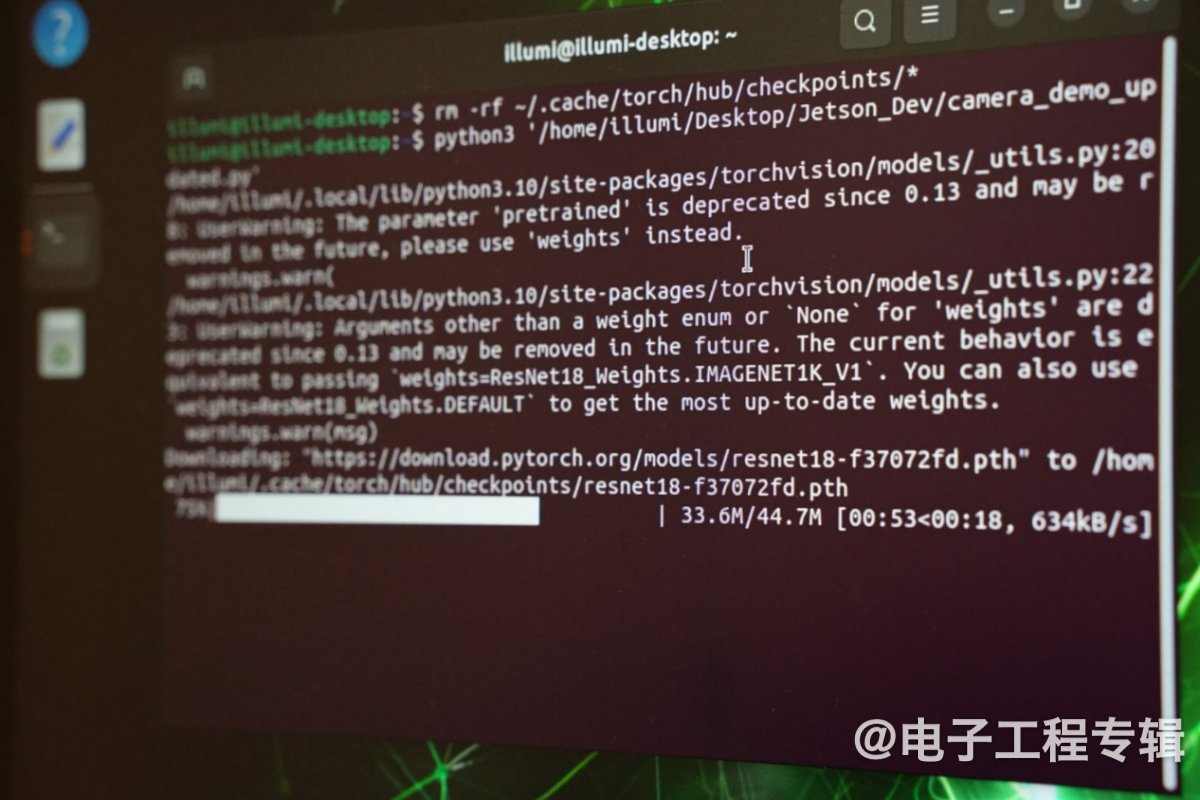

Copilot推荐了ResNet18模型:它现在就包含在Torchvision的预定义model zoo里面;这个模型的历史也比较悠久了,看名字就知道这是ResNet家族中的一员,网络架构18层,对算力资源要求较低;我直接用的ResNet18预训练版本基于ImageNet数据集,应用方向包括图像分类、特征提取、迁移学习...

首次执行脚本,下载ResNet18预训练参数

Copilot也给我说明了为什么推荐ResNet18,因为够简单——毕竟我只是写个demo。看人家还记得我最早提出的只做demo的需求;虽然感觉ResNet18对Jetson Orin Nano 8GB有点大材小用了。

最终写出来的Python脚本思路是这样的:首先加载ResNet18模型,定义一个model方法;定义图像转换方法(一个pre-process流程)——包括resize, normalize之类的操作;开启摄像头,尔后将摄像头捕捉到的帧转为PIL图像,对图像执行pre-process方法,执行AI推理操作(model方法),输出识别的结果——该操作外部加个while循环,直到用户手动关闭程序则结束。

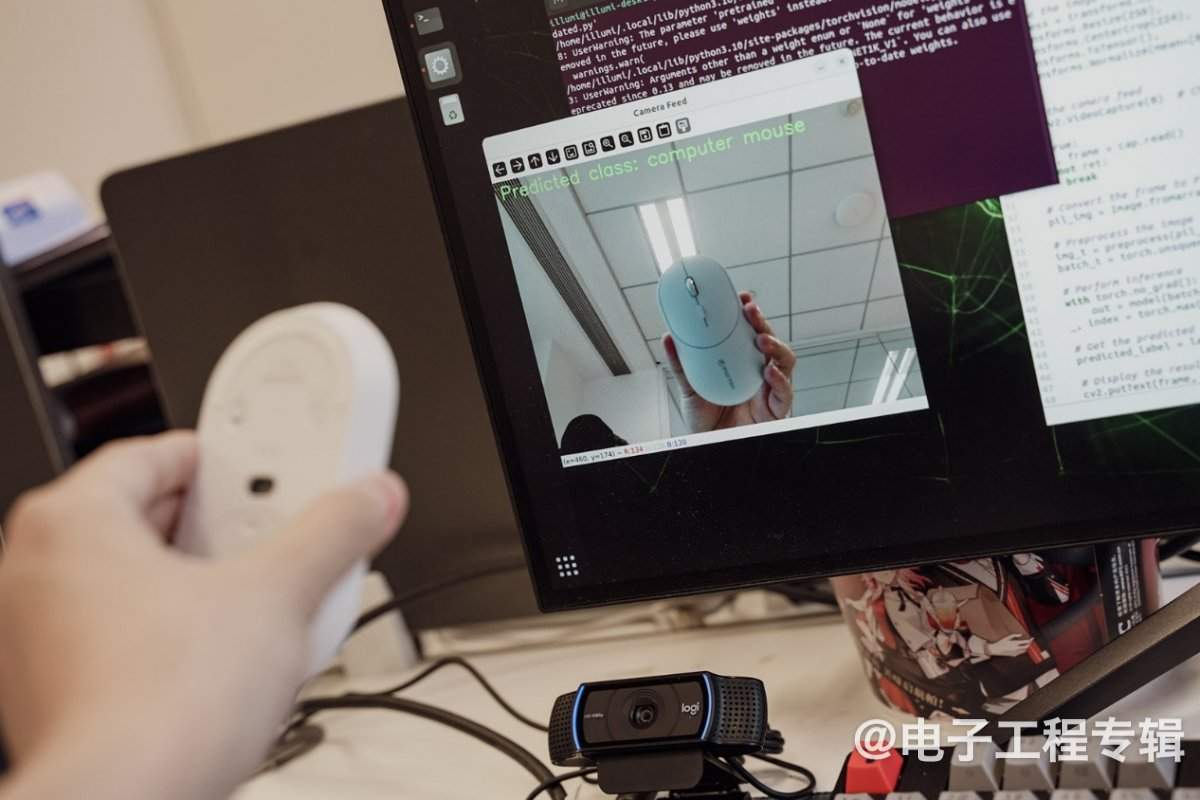

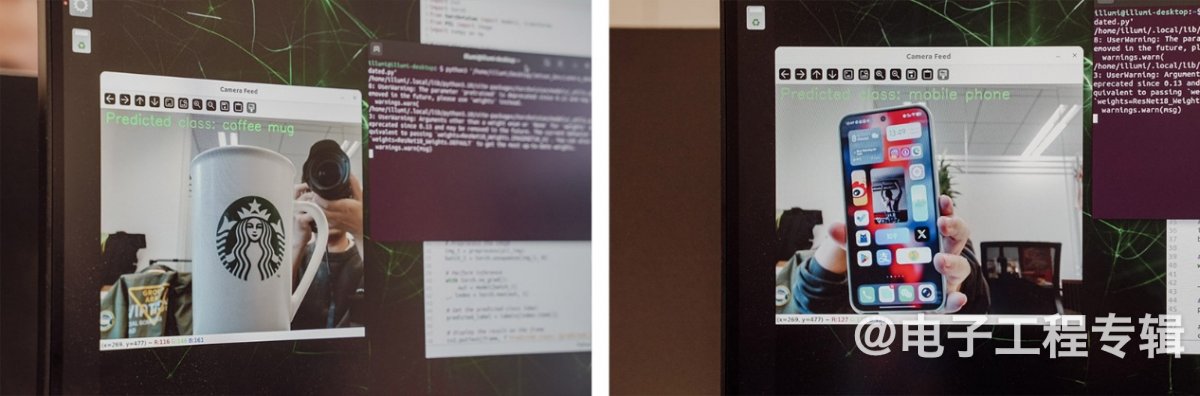

注意看画面中的“predicted class”,正确率还是挺高的

程序本身不复杂,主要看的是ResNet18模型能力如何。我用下来感觉效果还算是挺理想的,即便是在有背景画面干扰的情况下,识别画面中的主体对象,常规物体的识别效果都还不错,包括键盘、鼠标、单反、杯子、瓶子之类——基本是实时的,具体延迟没测,但至少也是毫秒级别。这类功能本质上就是一个系统边缘应用的子功能,不管是工业生产制造,还是零售、物流等等。

当然也不是什么东西都能识别,毕竟也就那么大点的模型……如此一来,我的首个AI应用也算是大功告成了:我自己的确是一行代码(包括命令行)都没有手写,全部是Copilot告诉我应该怎么写的;我全程只告诉它需求,以及出现了哪些bug...

识别错误:speaker…

这篇文章简化了整个过程,其中还有很多细节是没说的。比如说ResNet18输出的对象识别结果本身是数字,还需要将数字转为类别标签——所以斥责Copilot让它重写脚本;以及Copilot最早写出来的程序完全没有用到我准备好的摄像头,而单纯是个静态图像分类应用;还有依赖包安装过程中出现的各种奇怪问题,以及Github需要特别的网络连接方式...

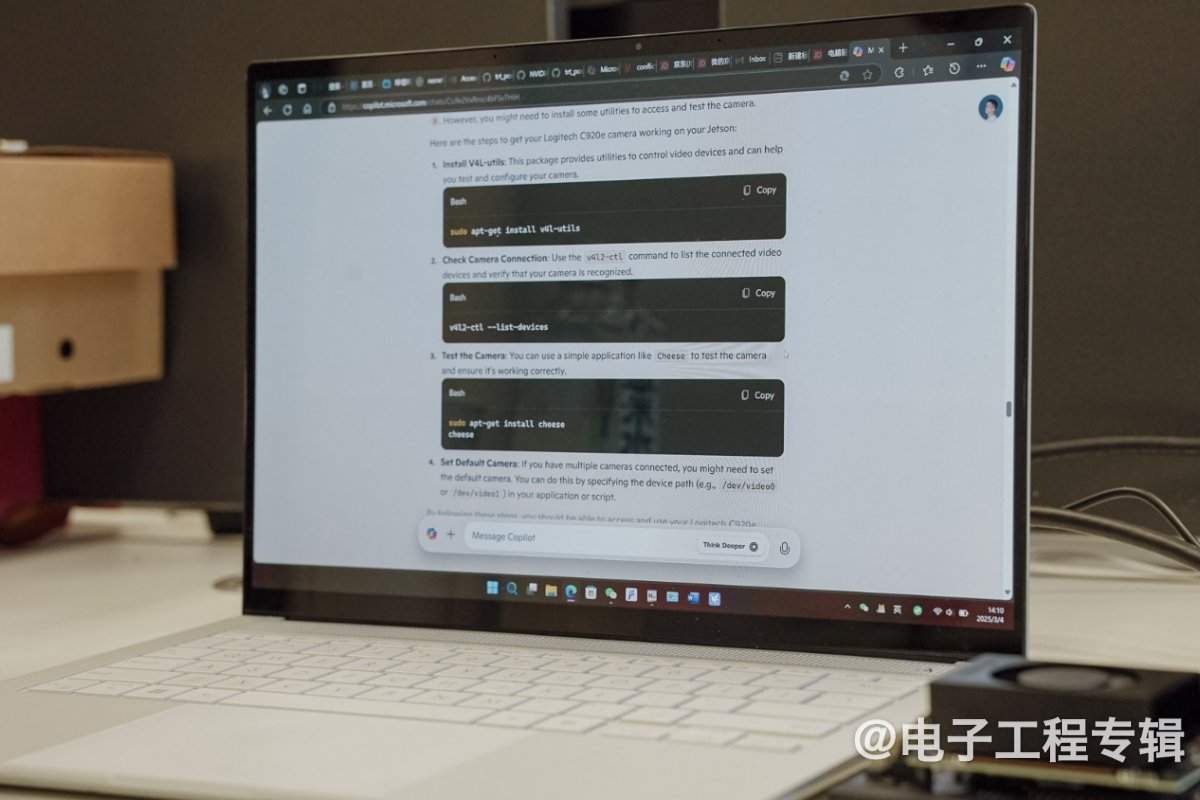

几乎所有细枝末节的问题全部是由Copilot解决的,整个开发过程,从Copilot让我买摄像头、microSD卡,到最后成品脚本写出来,以及我让它解释代码的含义等等,我们总共进行了50轮对话。其中也包括了发图片让它识别这种多模态大模型特性实现需求~整体体验还是比较丝滑的。

这台笔记本专门用来和Copilot对话的…

不过我以前没做过这类开发,感觉和Jetson本身准备好的软件栈、中间件、库及开发资源和生态也有关系:起码没有遇到嵌入式开发可能遭遇的那种非常细枝末节、需要花大量时间去处理的神经质问题。而且毕竟这只是个很简单的例子...

其实前年我用Copilot帮忙做过“算法导论”这门课的作业——一个相对复杂的程序,对话轮次起码有几百轮,而且涉及到算法这类需要强逻辑的问题时,LLM出错的概率也不小——需要反复商议和修正。听闻现在Cursor+Claude组合,在解决这类复杂开发的问题上已经很强了。

后续我准备再用Jetson Orin Nano Super开发套件来写个生成式AI应用,毕竟上面这个AI小应用完全没能充分利用它的算力——具体写什么还没想好,可能Chatbot之类的?另外还有很多人关心的图形性能问题,以及Jetson Orin Nano Super有没有机会和性能作为小PC去投入日常使用,我都会去测一测,毕竟也是难得有这么开箱即用的开发板...